S2 ProはFish Audio Appで利用可能であり、そのオープンソース版はプロジェクトのGitHubリポジトリおよびHuggingFaceで公開されています。

Fish Audioは、[laugh]、[whispers]、[super happy]といった自然言語タグを使用して、韻律や感情をきめ細かくインライン制御できるテキスト読み上げ(TTS)モデル「S2」をオープンソース化しました。約50言語にわたる1,000万時間以上のオーディオで学習されたこのシステムは、強化学習によるアライメントとデュアル自己回帰(Dual-AR)アーキテクチャを組み合わせています。今回のリリースには、モデルの重み、ファインチューニング用コード、およびSGLangベースのストリーミング推論エンジンが含まれています。

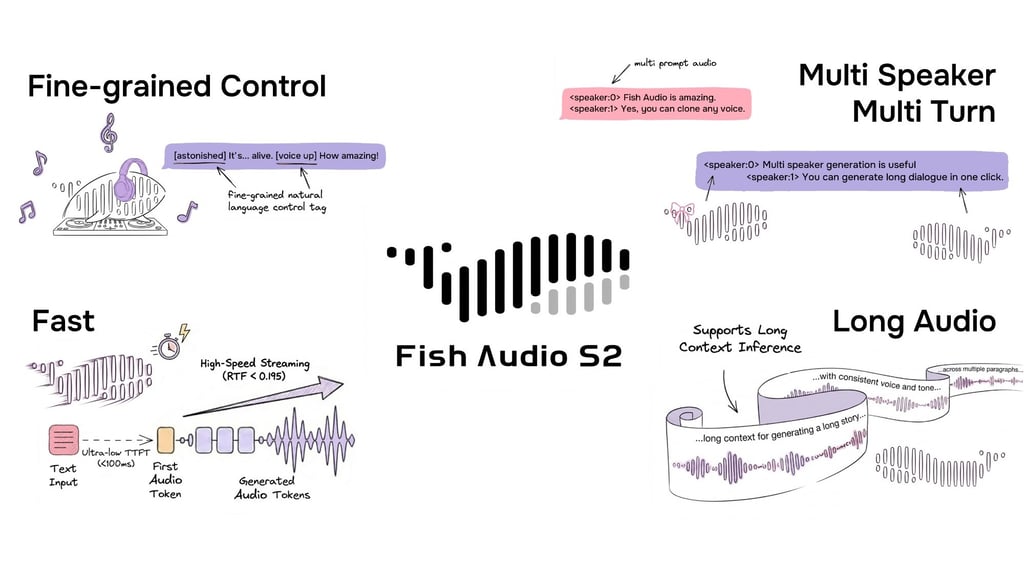

自然言語によるきめ細かなインライン制御

S2は、テキスト内の特定の単語やフレーズの位置に自然言語の指示を直接埋め込むことで、音声生成のインライン制御を可能にします。あらかじめ定義された固定のタグセットに依存するのではなく、S2は [whisper in small voice]、[professional broadcast tone]、[pitch up]といった自由形式のテキスト記述を受け付け、単語レベルでのオープンな表現制御を可能にします。

Audio Turing Testにおいて、S2は指示の書き換え(instruction rewriting)を行うことで0.515の後験平均を達成しました。これはSeed-TTSの0.417やMiniMax-Speechの0.387を上回る数値です。EmergentTTS-Evalでは、gpt-4o-mini-ttsをベースラインとして81.88%という総合勝率を記録しました。これは、GoogleやOpenAIのクローズドソース・システムを含む、評価されたすべてのモデルの中で最高値です。

きめ細かな制御のための自由形式の自然言語インラインタグを使用した、複数話者の対話を示すS2の入力形式の例。

きめ細かな制御のための自由形式の自然言語インラインタグを使用した、複数話者の対話を示すS2の入力形式の例。

統合されたレシピ:同一モデルからのデータキュレーションとRL報酬

S2の核となるアーキテクチャ上の決定は、トレーニングデータのフィルタリングとアノテーションに使用されたものと同じモデルが、強化学習(RL)時の報酬モデルとして直接再利用されている点です:

- 音声品質モデルは、データフィルタリング時にSNR、話者の一貫性、明瞭度などの次元でオーディオをスコアリングし、RL時には音響的嗜好の報酬として機能します。

- リッチ・トランスクリプションASRモデル(Qwen3-Omni-30B-A3Bから継続事前学習)は、データキュレーション中にインラインの副言語アノテーションを含むキャプション付き文字起こしを生成し、RL時には生成されたオーディオを再文字起こしして元のプロンプトと比較することで、明瞭度と指示追従の報酬を提供します。

この二役を担う設計により、事前学習データと事後学習の目的の間での分布の不一致を構造的に排除しています。これは、データパイプラインとは別に報酬モデルをトレーニングする他のTTSシステムでは未解決の課題です。

モデルの内部構造:Dual-ARアーキテクチャ

S2は、デコーダーのみのTransformerとRVQベースのオーディオコーデック(10個のコードブック、約21Hzのフレームレート)を組み合わせて構築されています。すべてのコードブックを時間軸に沿ってフラット化すると、シーケンス長が10倍に膨れ上がってしまいます。S2は、デュアル自己回帰(Dual-AR)アーキテクチャによってこの問題に対処しています:

- Slow ARは時間軸に沿って動作し、主要なセマンティック・コードブックを予測します。

- Fast ARは各タイムステップで残りの9つの残差コードブックを生成し、きめ細かな音響ディテールを再構成します。

この非対称な設計(時間軸方向に4Bパラメータ、深さ方向に400Mパラメータ)により、オーディオの忠実度を維持しながら、推論の効率性を保っています。

音声のための強化学習アライメント

事後学習には、長いオーディオコンテキストにおいてPPO方式のバリューモデルによるメモリオーバーヘッドを避けるため、Group Relative Policy Optimization (GRPO)を使用しています。報酬信号は、以下を含む複数の次元を組み合わせています:

- 意味の正確性と指示への忠実度

- 音響的嗜好スコアリング

- 音色の類似性

ベンチマーク結果

S2は、複数の公開ベンチマークにおいてトップレベルの結果を達成しています:

| ベンチマーク | Fish Audio S2 |

|---|---|

| Seed-TTS Eval — WER (中国語) | 0.54% (総合1位) |

| Seed-TTS Eval — WER (英語) | 0.99% (総合1位) |

| Audio Turing Test (指示あり) | 0.515 後験平均 |

| EmergentTTS-Eval — 勝率 | 81.88% (総合最高) |

| Fish Instruction Benchmark — TAR | 93.3% |

| Fish Instruction Benchmark — 品質 | 4.51 / 5.0 |

| 多言語 (MiniMax テストセット) — 最良 WER | 24言語中11言語 |

| 多言語 (MiniMax テストセット) — 最良 SIM | 24言語中17言語 |

Seed-TTS Evalにおいて、S2はQwen3-TTS (0.77/1.24)、MiniMax Speech-02 (0.99/1.90)、Seed-TTS (1.12/2.25)といったクローズドソース・システムを含む、評価されたすべてのモデルの中で最低のWERを達成しました。Audio Turing Testでは、0.515という数値でSeed-TTS (0.417)を24%、MiniMax-Speech (0.387)を33%上回りました。EmergentTTS-Evalでは、S2は特に副言語(勝率91.61%)、質問(84.41%)、構文の複雑さ(83.39%)において非常に強力な結果を達成しています。

SGLangによる商用レベルのストリーミング

S2のDual-ARアーキテクチャは標準的な自己回帰型LLMと構造的に同型であるため、継続的バッチ処理、Paged KV Cache、CUDAグラフのリプレイ、RadixAttentionベースのプレフィックスキャッシュなど、SGLangのLLMネイティブなサービング最適化をすべて最小限の修正で直接継承できます。

ボイスクローニングにおいて、S2はリファレンスオーディオのトークンをシステムプロンプトに配置します。SGLangのRadixAttentionはこれらのKVステートを自動的にキャッシュし、同じ音声がリクエスト間で再利用される場合に、平均86.4%(ピーク時90%以上)のプレフィックスキャッシュ・ヒット率を達成します。これにより、リファレンスオーディオのプリフィルのオーバーヘッドをほぼ無視できるレベルに抑えています。

単一のNVIDIA H200 GPUにおける性能:

- リアルタイム係数 (RTF): 0.195

- 最初のオーディオ出力までの時間: 約100 ms

- スループット: RTF 0.5未満を維持しながら3,000以上の音響トークン/秒

このリリースの重要性

S2は単なるモデルのチェックポイントではなく、モデルの重み、ファインチューニング用コード、そして本番環境対応の推論スタックを含む完全なシステムとしてリリースされました。

2つの設計上の選択が際立っています。第一に、データと報酬の統合パイプラインにより、他のTTSシステムがアーキテクチャレベルで対処できていなかった、事前学習と強化学習の間の分布の不一致という構造的問題を解消しました。第二に、Dual-ARアーキテクチャと標準的なLLMとの構造的同型性により、カスタムの推論インフラを必要とせず、LLMサービング最適化のエコシステムをフルに活用できる点です。

S2は、プロジェクトのGitHubリポジトリ、SGLang-Omni、HuggingFace、およびfish.audioのインタラクティブデモで利用可能です。